La utilización de subtítulos en vídeos no sólo es útil para personas con pérdida auditiva, sino que cada vez nos damos más cuenta de que son necesarios para todo el mundo. Si estamos en un entorno ruidoso, o un lugar donde no podamos dar volumen a nuestro dispositivo, podremos seguir disfrutando del contenido gracias a los subtítulos.

En anteriores posts os hemos hablado de cómo activar los subtítulos cuando vamos a ver un vídeo en Youtube, o cómo generar esos subtítulos en los vídeos que publicamos.

Hoy nos hemos venido a la Universidad Politécnica de València a conocer a Alejandro Pérez. Queremos que nos presente dos proyectos que utilizan tecnología de reconocimiento del habla para añadir subtítulos a cualquier tipo de vídeo.

Alejandro, ¿puedes presentarte a nuestros lectores?

Me llamo Alejandro Pérez, tengo 32 años y formo parte del grupo MLLP ( Machine Learning and Language Processing ) de la Universitat Politècnica de València . Estudié Ingeniería Informática y posteriormente un máster en Inteligencia Artificial en la misma universidad.

En los seis años que llevo como investigador trabajó para distintos proyectos, tanto europeos como a nivel nacional, todos ellos relacionados con la aplicación de tecnologías del habla (reconocimiento automático de la habla, traducción automática, síntesis de voz) en el ámbito de la educación.

¿Cómo surgen los proyectos PoliTrans y PoliSubs?

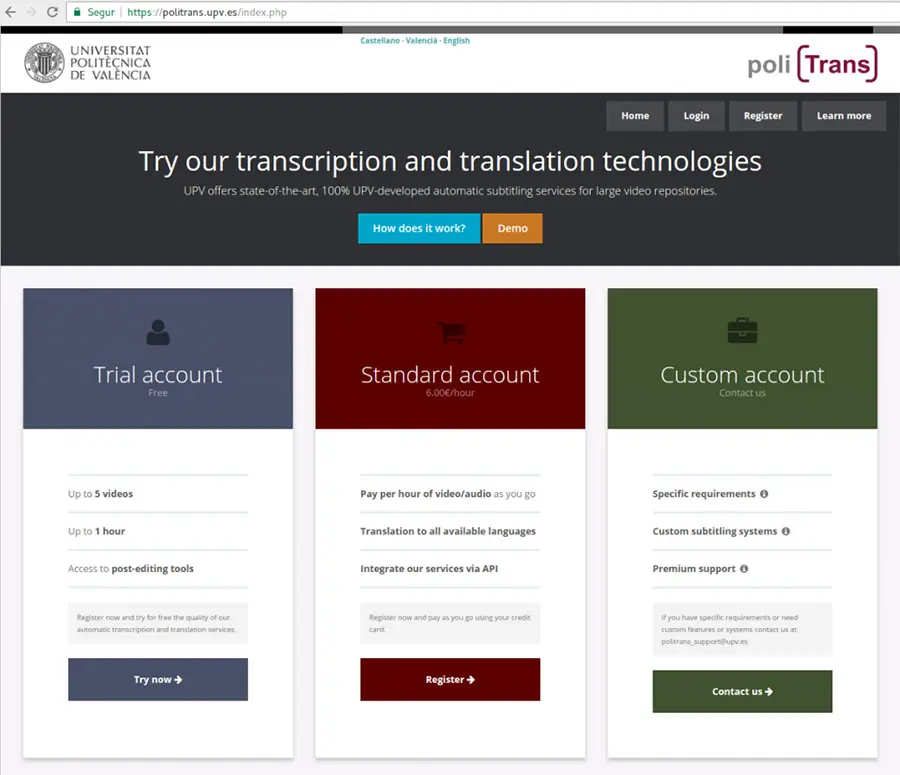

Entre 2011 y 2014 estuvimos coordinando proyectos europeos sobre transcripción automática de video-charlas educativas. Una vez finalizado, nos encontramos con que teníamos todo el software y el know-how necesarios para abrir su uso a cualquier organización o individuo interesados en transcribir y/o traducir automáticamente sus contenidos. De la mano de nuestros compañeros del Área de Sistemas de Información y Comunicaciones, en febrero de 2017 creamos la plataforma PoliTrans.

PoliSubs es una extensión reciente de PoliTrans, donde aplicamos estos sistemas en tiempo real para subtitular actos y conferencias.

¿Ambos proyectos fueron creados pensando que podrían ser beneficiosos para la comunidad sorda?

Por supuesto; se contempló desde el comienzo como uno de los posibles beneficios inmediatos: facilitar a la comunidad sorda el acceso a estos contenidos gracias al uso de tecnologías del habla. En PoliTrans y PoliSubs trabajamos en esa línea.

Hablando en concreto de PoliTrans, ¿puedes explicarnos brevemente su funcionamiento?

Su funcionamiento a nivel de usuario es bastante sencillo. PoliTrans ofrece un portal web donde puedes registrarte y subir tus vídeos para que sean transcritos y traducidos automáticamente. Una vez generados los subtítulos automáticos, puedes corregirlos a través de una aplicación web para subsanar posibles errores en la traducción antes de descargarlos.

En cuanto a los idiomas que soportamos actualmente, para transcripción: español, catalán, inglés, francés, portugués y alemán. Para traducción: de todos estos idiomas a inglés, y de inglés a español, catalán y francés. También soportamos la traducción de catalán a español y de español a catalán.

Quien desee traducir un audio/vídeo con vuestro sistema, ¿qué «precauciones» debe tomar?

Bueno, primero de todo intentar que el audio sea lo más limpio posible: evitar ruidos de fondo, saturación y reverberaciones. En general, si el locutor está cerca del micrófono es más fácil que la calidad del audio sea mejor. También se obtienen mejores resultados si los locutores no se solapan: es decir, no hay varias personas hablando al mismo tiempo. Por supuesto, una buena vocalización también ayuda a que el sistema cometa menos errores. Tener un discurso claro y sin interrupciones ayuda a obtener buenos resultados.

¿Puedes explicarnos brevemente el funcionamiento de PoliSubs?

PoliSubs es un sistema en fase de pruebas, y de momento solamente lo usamos dentro de la universidad para subtitular en vivo actos y conferencias. Funciona de la siguiente manera: conectamos un micrófono o entrada de audio a un emisor, que se encarga de enviar por streaming el audio recogido a un servidor remoto. Este servidor ejecuta un proceso de reconocimiento automático del habla sobre el audio, y devuelve la transcripción en tiempo real, que puede ser posteriormente mostrada en cualquier tipo de dispositivo: desde un proyector en la misma sala hasta en los smartphones de los asistentes.

PoliTrans ofrece un portal web donde puedes registrarte y subir tus vídeos para que sean transcritos y traducidos automáticamente Compartir en XEn un futuro, ¿podríamos utilizar PoliSubs en cualquier lugar?

De momento, como comentaba anteriormente, PoliSubs está en fase de pruebas. Sin embargo, el servicio ha sido desarrollado para que pueda utilizarse de manera remota por cualquier individuo u organización a través de Internet. De hecho ya hemos hecho algunas pruebas y han sido muy satisfactorias.

¿Qué funcionalidades nuevas o mejoras creéis que pueden tener ambos proyectos?, ¿puedes adelantarnos alguna novedad?

Bueno, en ambos casos, claro está, trabajamos continuamente en que los sistemas automáticos sean más robustos y cometan cada vez menos errores. La tecnología avanza muy rápido y tenemos que estar al día en las continuas mejoras que se publican en este ámbito, tanto por la comunidad investigadora como recientemente por las propias empresas tecnológicas (Google, Apple, Facebook, etc.) que se dedican también a esto. Por otro lado, soportar en la medida de lo posible cuantos más idiomas posibles.

En el caso de poliSubs, estamos estudiando la posibilidad no solamente de subtitular en vivo, sino además de traducir esos subtítulos a otros idiomas también en tiempo real.

Como veis, otro ejemplo de cómo la tecnología puede facilitar la vida a las personas sordas . Esa es la filosofía de Visualfy, y por ellos os invitamos a que conozcáis nuestro dispositivo Visualfy Home , que a través de su algoritmo de reconocimiento de sonidos, detecta los sonidos que se producen en los hogares y los traducen en señales visuales 100% accesibles . Os sorprenderá tanto como estas tecnologías que os hemos presentado.